- eGPU для Mac. Что это, и есть ли ему практическое применение?

- Что такое eGPU?

- Зачем это нужно?

- Есть ли минусы?

- Что еще нужно знать?

- Лонгриды для вас

- Что за тайная коробка Apple?

- Опыт сборки eGPU и его взаимодействие с ноутбуком

- Введение

- Немного о теории и компонентах eGPU

- Покупка и процесс сборки

- Установка и запуск системы

- Тестирование

- Благодарности

- Ссылки

eGPU для Mac. Что это, и есть ли ему практическое применение?

В недавнем релизе macOS 10.13.4 Apple привнесла полноценную поддержку внешних графических процессоров (eGPU). Сегодня мы подробно разберем, для чего это нужно, и как это может помочь в работе.

Что такое eGPU?

Как следует из названия, это док-станция с внешней видеокартой, которая подключается через быстрый интерфейс Thunderbolt 3. Разумеется, бокс идет в комплекте с блоком питания, который и обеспечивают необходимую мощность. Видеокарта обычно в комплект не входит, и её нужно докупать отдельно. Само собой, перед покупкой графического адаптера необходимо проверить совместимость на сайте производителя бокса.

Хоть такой тип адаптеров существует уже давно, возможности старых интерфейсов (таких как USB и FireWire) не позволяли раскрыть видеокарту на полную мощь, из-за чего смысла в подобных решениях попросту не было. Но с приходом Thunderbolt 3 всё изменилось – благодаря превосходной скорости в 40 Гбит/с.

Зачем это нужно?

По заявлениям Apple, внешние видеокарты позволяют серьёзно улучшить производительность в приложениях, которые используют Metal, OpenGL и OpenCL. Помимо всего прочего будет возможность подключить дополнительные мониторы, обходя ограничение встроенных видеокарт.

Огромное преимущество использования eGPU заключается и в том, что вы можете использовать эти мощности на любом Mac с Thunderbolt 3. Это означает, что вы можете превратить в мощную рабочую станцию даже MacBook Pro. При условии топового решения такие задачи, как монтаж видео в 4К, работа с 3D графикой и VR, и даже новейшие игры – больше не будут проблемой. А по окончании работы будет достаточно просто отключить адаптер и снова получить мобильное решение.

Есть ли минусы?

В некоторых случаях производительность eGPU может ограничиваться процессором. Кроме того, не все приложения могут поддерживать подобное ускорение.

Что еще нужно знать?

Ранее Apple официально не поддерживала такие решения, и поддержка осуществлялась исключительно производителями док-станций – соответственно, были проблемы с подключением и драйверами. Теперь, с приходом 10.13.4 мы можем быть уверены в стабильной работе подобных адаптеров. К сожалению, Apple по какой-то причине отказалась от поддержки видеокарт производства NVIDIA. На веб-сайте Apple можно увидеть список рекомендуемых боксов для конкретных видеокарт:

Для графических адаптеров AMD Radeon RX 570, RX 580, и Radeon Pro WX 7100:

- OWC Mercury Helios FX3

- PowerColor Devil Box

- Sapphire Gear Box

- Sonnet eGFX Breakaway Box 350W

- Sonnet eGFX Breakaway Box 550W

- Sonnet eGFX Breakaway Box 650W

Для графических адаптеров AMD Radeon RX Vega 56:

- OWC Mercury Helios FX3

- PowerColor Devil Box

- Sonnet eGFX Breakaway Box 550W

- Sonnet eGFX Breakaway Box 650W

Для графических адаптеров AMD Radeon RX Vega 64, Vega Frontier Edition Air, Radeon Pro WX 9100:

Sonnet eGFX Breakaway Box 650W

Apple рекомендует подключать бокс непосредственно в разъем USB-C, избегая использования переходников. К сожалению, компьютеры Mac с интерфейсом Thunderbolt первого и второго поколения не получили поддержку eGPU из-за недостаточной скорости передачи данных.

Как вы считаете, стоит ли пользоваться подобным решением? Если нет, то почему?

Новости, статьи и анонсы публикаций

Свободное общение и обсуждение материалов

Лонгриды для вас

Apple откладывает полноценный переход на Apple Silicon на неопределённый срок. По крайней мере, новый Mac Pro, который выйдет в 2022 году, будет работать на процессорах Intel, которые оказались круче, чем M1X и M2

Не знаете, какой монитор для Mac выбрать? Лучше всего тот, который может заряжать MacBook и передавать данные по одному кабелю. Нашли несколько таких мониторов.

После ухода Джони Айва из Apple её продукция реально стала лучше. В компании перестали ориентироваться только на внешнюю красоту, но и задумались о практичности. Это изменение коснулось почти всех ключевых устройств бренда

Вот интересно почему Apple резко охладела к nvidia? Вроде никаких скандалов и противоречий не было у них начиная с 2014 года (тогда вышел MacBook Pro 15 c GT750 на борту).

По сути видеокарты GeForce сейчас в лидерах по производительности. Плюс грамотно написаные драйвера.

Radeon всегда славился криво написанными драйверами, из-за чего частенько падают программы в которых задействована их мощность. Это и к играм относится тоже. Ну и Radeon практически всегда был номер 2 после GeForce по производительности.

Единственный плюс — цена была ниже.

Что касается отсутствия поддержки GeForce в mac, то особо переживать не стоит, она спокойно поддерживается самой nvidia, по крайней мере драйвера для mac от 1080/Ti есть. Скорее всего и 1050/60/70 тоже работают в качестве eGPU c Mac.

Другое дело, что цена самих боксов отпугивает. 500-600$ + сама видеокарта = за 100К ₽. Если сюда ещё прибавить стоимость MacBook Pro(13/15), то это будет уже за 200К ₽.

Источник

Что за тайная коробка Apple?

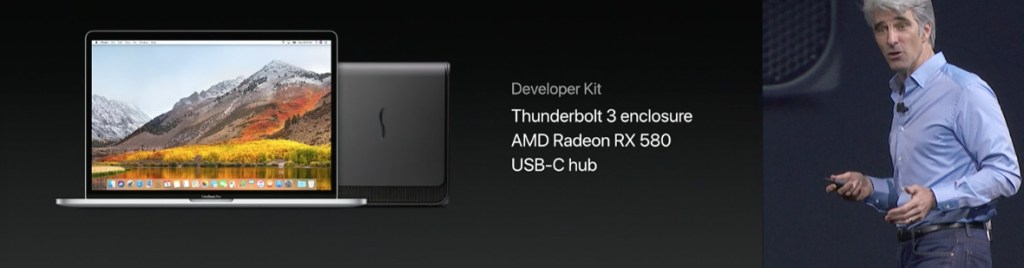

Думаю, у многих при просмотре кейноута WWDC возник вопрос – какую такую коробочку для внешних видеокарт показывает Apple? Почему именно ее и где ее купить? Ответ очень простой – купить можно на сайте Apple, правда, в том случае если вы разработчик под MacOS из Европы, Австралии или США.

Sonnet EGFX Breakaway Box, а именно так называется та самая внешняя коробка для карт, входит в состав “External Graphics Development Kit”, который также включает видеокарту AMD Radeon RX 580 8GB, хаб на 4 USB-A порта и промокод на приобретение HTC Vive со скидкой 100 долларов. Всё это всего за 599 долларов.

Apple в рамках заботы о разработчиках практически не зарабатывает на этом комплекте, по крайней мере, если брать розничные цены. Breakaway Box с блоком питания на 350 ватт обойдется вам в 300$, RX580 8Gb 250$ в лучшем случае, в реальности 300$ и больше, плюс хаб от Belkin еще 50$. Промокод в подарок. Неожиданная щедрость от купертиновцев!

Набор доступен к заказу по этой ссылке.

Но если вы не разработчик, а внешнюю видеокарту подключить хочется, Sonnet EGFX Breakaway Box действительно один из лучших вариантов на рынке, который совместим не только с картами AMD, но и с Nvidia, включая 10ю серию. Breakaway Box умеет одновременно выводить изображение на экран ноутбука и на внешние мониторы, которые подключены к выходам видеокарты, а на такое способны далеко не все схожие решения.

В версии на 350 ватт два разъема питания для видеокарты на 8 и 6 пинов, GTX 1080 поставить не получится.

На ноутбук Sonnet EGFX отдает всего 15 ватт, и для того чтобы он не разряжался, придется держать его на зарядке.

Позже, в третьем квартале, появится и версия на 550 ватт, вот в ней будет два 8-пиновых разъема для питания видеокарты, а на ноутбук будет отдаваться уже до 87 ватт, что как раз равняется мощности комплектного зарядного устройства для Macbook pro.

Конкурирующее решение Razer Core обойдется в 500$. Да у него блок питания на 500 ватт, встроенный гигабитный ethernet и 4 порта USB, но во-первых, 200$ разницы, а во-вторых, 200$ разницы — это 200$.

Мне коробки для внешней видеокарты казались довольно сомнительным приобретением, но теперь в свете того, что Apple не против, а ЗА их использования и возможно даже каким-то образом оптимизирует под них Mac OS… лишь отсутствие лишних 700$ на комплект коробка-монитор-видеокарта останавливает меня от покупки.

Источник

Опыт сборки eGPU и его взаимодействие с ноутбуком

Введение

Добрый день, уважаемое хабро-сообщество. По профессии я человек далёкий от IT, однако, практически все, так или иначе касающиеся данной сферы статьи мне очень интересны, поскольку в душе я тот еще гик.

Немного о теории и компонентах eGPU

Итак, вы хотите рискнуть и провернуть операцию “eGPU”, но не знаете с чего начать? У вас много вопросов типа: «Подойдёт ли к ноутбуку eGPU?, «Какую видеокарту выбрать?», «Какой блок питания приобрести?» и т. д. Тогда вы можете смело обращаться сюда(в качестве непосредственного общения с владельцами) и к материалам этого сайта (в качестве справочника, поскольку идейный вдохновитель движения eGPU – nando4, после несправедливого бана, и другие важные участники переехали на techinferno).

Говоря в двух словах, система на eGPU – это своеобразный тандем из ноутбука, стационарного блока питания и дискретной видеокарты, соединённых между собой посредством интерфейса ExpressCard \ слота mPCIe и ключевого компонента – адаптера, за счёт которого происходит конвертация в PCI Express. Делая небольшое отступление, стоит отметить, что на рынке существует исполнение для порта Thunderbolt как в DIY варианте – TH05, так и в готовом – Echo Express SE Thunderbolt Expansion Chassis, однако, на сегодняшний день такая покупка была бы не совсем резонной, поскольку при использовании порта Thunderbolt не активируется режим компрессии PCI-E, что сказывается на общей производительности. Однако на горизонте мелькает перспектива ещё более быстрого поколения Thunderbolt порта, который обеспечит производительность PCI-Express 3.0. Возвращаясь к основной нити повествования, приходится констатировать, что остаётся выбирать между исполнениями на основе ExpressCard и mPCIe, среди которых есть дешёвые – PE4L

и PE4H

, а также не совсем дешёвые, более эстетичные и менее энергозатратные варианты – Magma ExpressBox

и ViDock.

Как только мы решили для себя, какое eGPU решение лучше, следующим этапом будет выбор видео карты. Принимая во внимание то, что видеокарта будет использоваться на ограниченном, по пропускной способности, порту, свой выбор нужно делать на картах средней и высшей категорией любой из серий GTX 460/470, GTX 560/570, GTX 660/670. Причём, сравнивая родственные категории видеокарт, например GTX 570 и GTX670, разница в производительности будет не очень существенна. Вы можете проанализировать данный вопрос более подробно, используя данную таблицу в качестве образца.

Допустим, ваш выбор пал на линейку nVIDIA GeForce 670 GTX. Следующим шагом будет – изучение потребляемой мощности и силы тока, которые необходимы для нормального функционирования видео карты. Так, для серии GeForce 670 GTX необходим источник питания, дающий на выходе мощность 12 В с силой тока минимум 30А. Несоблюдение данных условий может стать причиной быстрого выхода из строя вашей видеокарты.

В свою очередь, исходя из выше упомянутых параметров видеокарты, должен выбираться блок питания(прим. далее БП). Рекомендуемая мощность БП для серии GTX 670 колеблется в приделах от 500 до 600 Вт. Лучшим ориентиром будет выбор БП с запасом по мощности +50 Вт. Таким образом, для работающей на стандартных частотах GeForce 670 GTX это будут БП 550-600 Вт, для карт с заводским разгоном желательно 650 Вт.

Любителям высоких разрешений придётся дополнительно растратиться на внешний монитор. Здесь стоит отметить то, что eGPU может использоваться как с внешним монитором, так и с дисплеем ноутбука. И если с подключением внешнего монитора всё ясно как день, то при использовании дисплея ноутбука не всё так просто, а для некоторых владельцев ноутбуков и вовсе невозможно в плане реализации.

Всего существует три, широко используемых на практике, способа:

1) С использованием технологии nVIDIA Optimus. Основными условиями являются: естественно, наличие видеокарты nVIDIA (начиная с последних карт на архитектуре Fermi и более новыми) и встроенного видео Intel моделей 4500MHD/HD/HD3000/HD4000. При использовании данного метода, драйвер nVIDIA клонирует изображение с внешней видеокарты на дисплей ноутбука, при этом данный процесс оказывает незначительное влияние на производительность видео подсистемы. Другими словами – скорость видеокарты, подключённой напрямую к внешнему монитору, будет несколько выше, нежели чем при использовании дисплея ноутбука.

2) Метод Ultramon/Chung Gun . Данный метод подойдёт владельцам видеокарт фирмы ATI и ранних моделей карт nVIDIA. Он схож с вышеописанным, за исключением того, что 3D программы могут запускаться только в оконном режиме.

3) Третий способ основан на использовании HDMI ExpressCard конвертера – HD80E HDMI Express Video Capture Card. Плюсом данного варианта является то, что он лишён скоростных ограничений двух предыдущих, однако, для его применения, вам потребуется свободный слот mPCIe, к которому будет подключаться eGPU.

Ну и конечно последний компонент, без которого вся операция была бы бессмысленна, это – ноутбук. Как уже было упомянуто выше, если вы планируете использовать eGPU только с дисплеем ноутбука, лучшим вариантом будет видеокарта от nVIDIA и ноутбук с интегрированным видео моделей 4500MHD/HD/HD3000/HD4000. Для того, чтобы получить максимальную производительность, желательно чтобы процессор вашего ноутбука был основан на микроархитектуре Sandy Bridge, или ещё лучше Ivy Bridge. Так, в случае Sandy Bridge ноутбуков, вы получаете ExpressCard интерфейс второго поколения с пропускной способностью 500 MB/s, что в купе с компрессией драйвера nVIDIA Optimus даёт очень и очень неплохую производительность.

Обобщим. Для системы, основанной на eGPU, нам потребуются:

– Прямые руки и светлая голова.

– Ноутбук.

– Адаптер eGPU (выбираем в зависимости от ноутбука, потребностей, бюджета и т.д.).

– Видеокарта (аналогично…).

– БП (незабываем о мощности и силе тока, а также рекомендациях производителей конкретных карт касательно энергозапросов той или иной модели).

– Внешний монитор (опционально).

Покупка и процесс сборки

Итак, вы определились с комплектующими, заказали, получили заветные коробочки, распаковали, разложили, изучили руководство. Приступаем к сборке!

Сразу отмечу, что во время покупки не преследовалась цель – сэкономить, поэтому видеокарта одна из самых лучших в своей категории и БП не подкачал. Причиной тому были некоторые опасения – не заработает, не понравится и т. д. и т. п., в случае чего, всё можно было продать или вернуть (некоторые продавцы дают семь дней на пробы) без существенных убытков. Покупалось всё на TaoBao. Но, забегая вперёд, скажу, что всё работает и скорее всего, ничего возвращать, или продавать я не буду.

Всё тестировалось с использованием адаптера eGPU PE4L 2.1b на ноутбуке Lenovo X220, чьим счастливым владельцем я и являюсь. Конфигурация максимальная, выражаясь точнее – i7-2640M\8GB\HDD320GB.

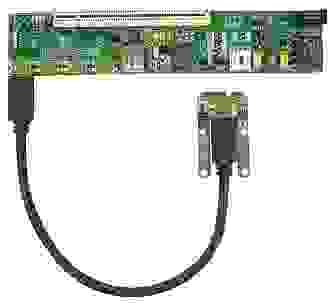

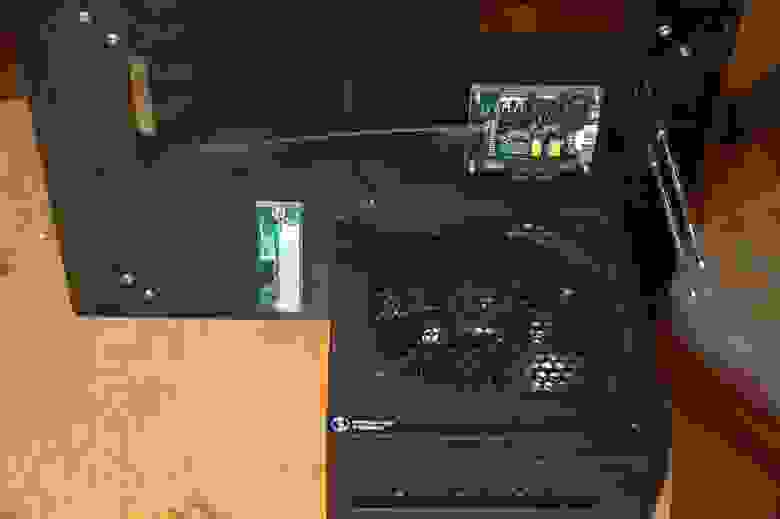

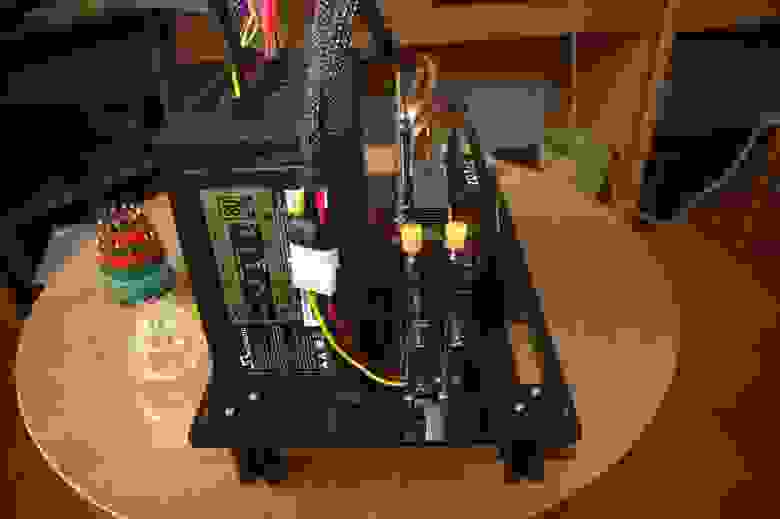

Помимо основных компонентов, был куплен акриловый корпус, от той же компании, которая производит адаптеры PE4L и PE4H. С него мы и начнём.

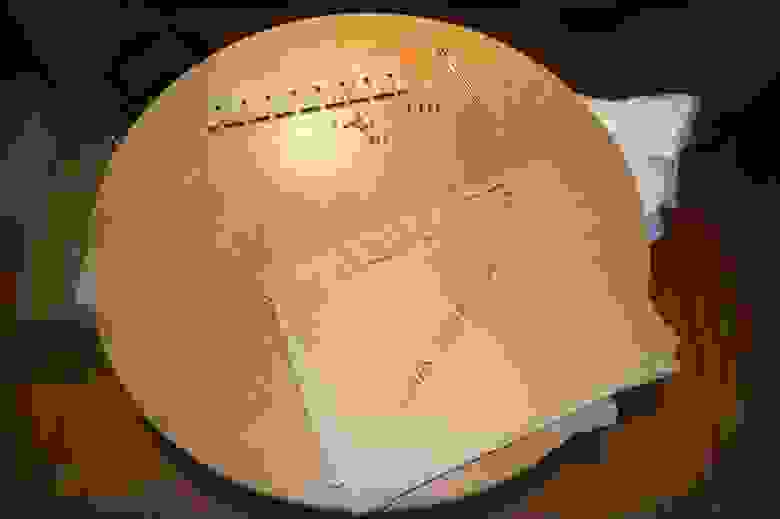

Распаковываем и достаём, аккуратно размещаем компоненты. Каждая акриловая деталь корпуса для защиты от царапин обклеена плотной бумагой, которую можно содрать или оставить как есть, в любом случае – это никак не повлияет на поток воздуха или работоспособность готовой системы. Я решил содрать.

Собираем ножки и крепим к днищу корпуса. Здесь стоит пожурить создателей за то, что не просверлили по два отверстия на каждом из рёбер, так готовая конструкция была бы монолитнее. После прикручивания к днищу, рёбра без отверстий немного шатаются. Однако в конце сборки общий вес конструкции исправляет ситуацию.

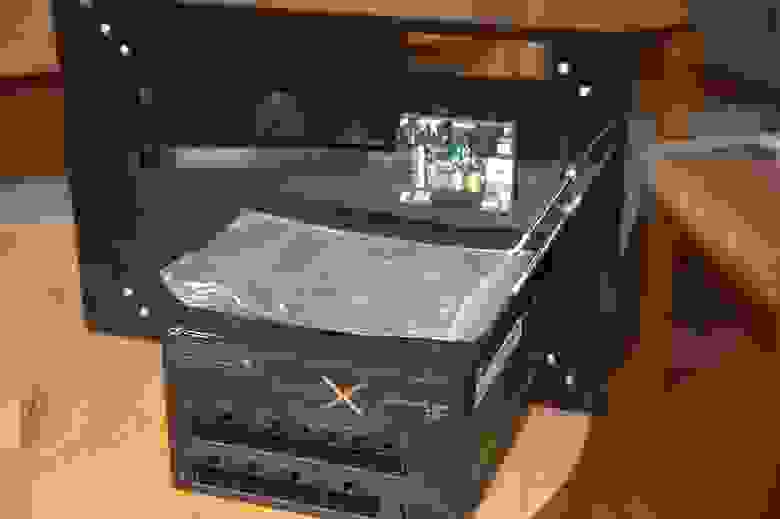

После того, как готова опора, переходим к самому тяжёлому компоненту – БП. В акриловом днище просверлены отверстия для разных вариаций БП, так что проблем с совместимостью быть не должно. Для своей системы я использовал БП на 660 ватт фирмы Seasonic, серия Х. Подробнее об этом БП можно почитать здесь. Всё крепится на довольно прочные на вид болты.

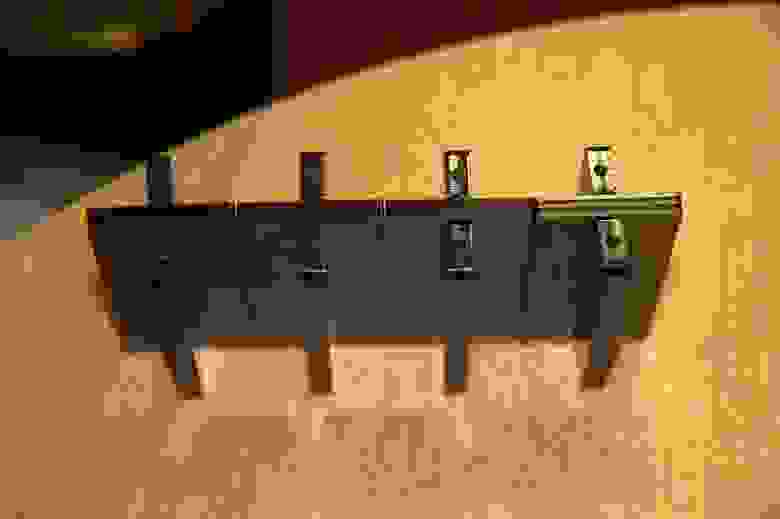

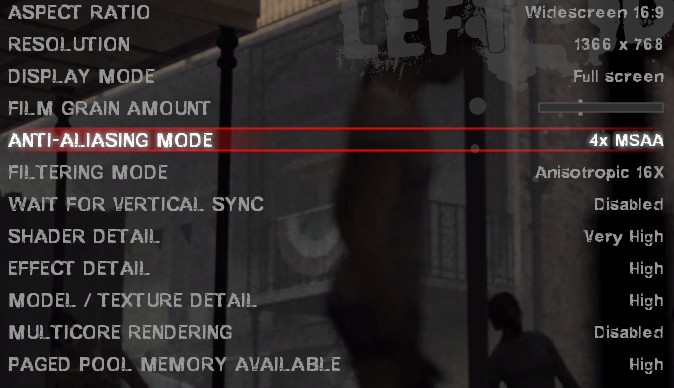

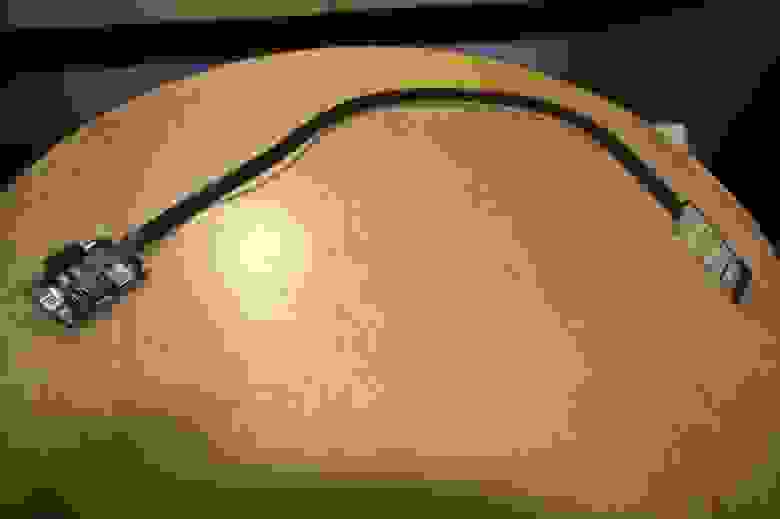

Пришёл черёд компонентов адаптера eGPU, среди которых: SWEX-гнездо для блока питания, кабель питания, соединительный кабель для адаптера и переключателя питания и, непосредственно, сам адаптер PE4L.

Извлекаем адаптер из обёртки. Адаптер выполнен на куске текстолита темно-синего цвета, к которому дополнительно прикручен текстолит зелёного цвета. Такое «сэндвич» решение не случайно, так как в процессе продолжительной работы данный элемент eGPU может существенно нагреваться. Сначала нужно отвинтить идущие по умолчанию винтики и гайки. Затем, попутно подложив что-нибудь на решётку вентилятора БП (прим. гайки и винтики маленькие, легко уронить), привинчиваем адаптер к днищу корпуса. Во время сборки был замечен ещё один недочёт – два из четырёх отверстий по диаметру были несколько больше винтиков, поэтому в качестве решения были использованы идущие в комплекте с адаптером картонные изоляционные шайбы.

Прежде чем перейти к следующему шагу, рассмотрим подробнее устройство адаптера.

На нём находятся:

1. Порт USB 2.0.

2. Разъём питания для подключения внешнего БП.

3. Floppy разъём питания.

4. Переключатель принудительного обнаружения PCI карт со скоростями выше первой (т.е. x2,x4, x8, x16).

5. PCI-гнездо.

6. Переключатель CLKRUN# (в описании говорится, что переключатель используется для того, чтобы избежать обнаружения BIOS’ом PCI карты для конкретного промежутка времени. Если я не прав или описание врёт, прошу поправить. Как бы там ни было, у меня всё отлично запустилось на параметре 500ms).

7. Разъём для подключения провода, соединяющего адаптер eGPU и переключатель питания SWEX-гнезда.

Следующий шаг – установка опор для видео карты. Ничего сложного. В том случае, если планируется использование монитора и одна из опор будет загораживать видео выход, тогда можно оставить лишь одну. В моём случае ничего не убиралось, поскольку изначально планировалось использовать только дисплей ноутбука.

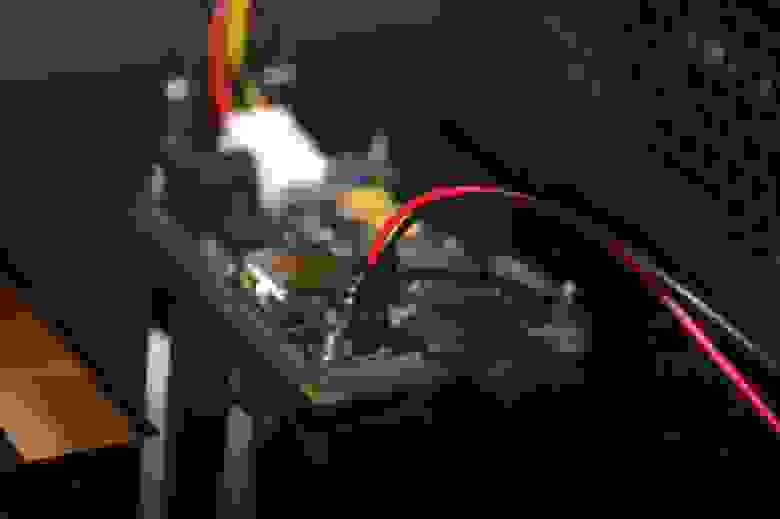

Переходим к подключению БП к SWEX-гнезду, адаптеру eGPU, и затем, соединяем адаптер eGPU с переключателем питания.

Важный момент – при подключении соединительного кабеля для адаптера eGPU и переключателя питания необходимо соблюдать полярность.

Почти готовая конструкция выглядит так. Осталось подключить последний компонент – видеокарту. Ах! Этот восхитительный запах свежего текстолита!

Вставляя карту в гнездо, нужно быть осторожным с проводами и потуже затянуть винтики на опорах. Дело за малым – установить последние акриловые панели и начать тестирование.

Стоит отметить, что производитель корпуса не стал просверливать в стенках отверстия для последующего их закрепления с помощью винтиков, а просто ограничился специальными выступами, которые вставляются в пазы днища. На мой взгляд, это тоже просчёт. Даже если принимать во внимание то, что это было сделано с целью невозможности переноски корпуса, держась за боковые панели (прим. в сравнении с весом внутренностей корпуса, акриловые панели выглядят не настолько прочными. По этой причине, даже если бы они были закреплены винтами, существует большой риск поломки и последующего выпадения днища).

Когда я сосредоточенно разглядывал уже собранную систему в процессе работы, мой сосед удачно пошутил, сказав: «Теперь у тебя на столе персональное IT-порно».

Установка и запуск системы

Итак, мы подходим к завершающему и самому волнующему для меня моменту – запуску системы.

Предварительно, нам необходимо скачать последние драйвера для видеокарты. После чего запускаем процесс установки, в процессе которого программа рапортует, что не обнаружено ни одного подходящего видеоадаптера. Переводим ноутбук в спящий режим. Необходимо заметить, что переводить в спящий режим нужно только в процессе установки драйверов. В будущем, можно вставлять ExpressCard адаптер в соответствующий слот после включения eGPU, прямо в процессе работы ноутбука. В свою очередь, перед отсоединением обязательным является использовать функцию «безопасного извлечения устройств».

Передвигаем переключатель на БП (если есть) и SWEX-гнезде в положение ВКЛ. О том, что всё идёт как надо, будут свидетельствовать работающие вентиляторы видеокарты, БП и оранжевый с зелёным диоды на плате адаптера eGPU. Подключаем ExpressCard адаптер к гнезду, выводим ноутбук из спящего режима. Программа установки должна определить подключение видеокарты, нажимаем далее и выполняем чистую установку. Перезагружаемся. Мы готовы к тестированию!

Тестирование

Хочу подчеркнуть, что все тесты проводились с использованием дисплея ноутбука, что вносит свои коррективы в получаемые результаты. При использовании внешнего монитора результаты будут намного лучше. Кроме того, система не была никоим образом оптимизирована (надстройки реестра, предварительная дефрагментация, отключение визуальных стилей ОС и пр.).

– Lenovo x220 i7-2640M\8GB\HDD320GB

– Display IPS native resolution 1366×768

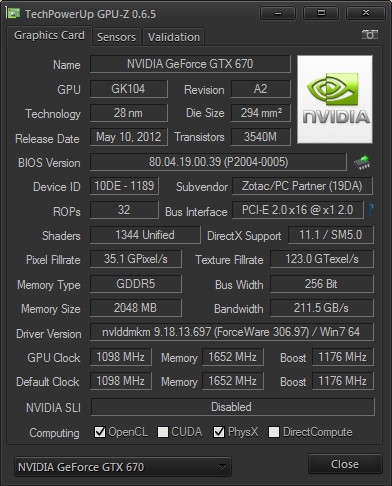

– ZOTAC GeForce GTX 670 AMP! Edition 2 GB (без разгона)

Программы для тестирования:

– 3DMark 11 Basic Edition

– Resident Evil 5 Benchmark Version

– Sleeping Dogs Benchmark Mode

– Battlefield 3 (FRAPS)

– Left4Dead2 (FRAPS)

Для того, чтобы было с чем сравнивать, тесты проводились на интегрированном видео от Intel (в моём случае это Intel HD Graphics 3000). Итак, результаты:

По понятным причинам, на интегрированном видео последний 3D Mark не запускается, поэтому результаты только для GTX 670. Базовая версия, все настройки по умолчанию. Итого получилось 6034 очков.

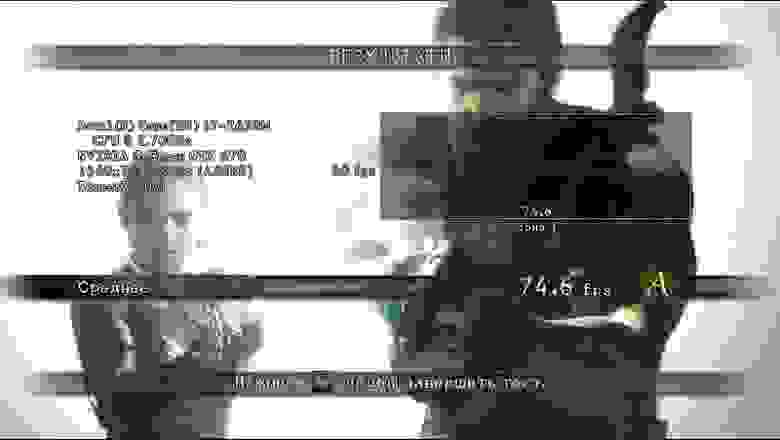

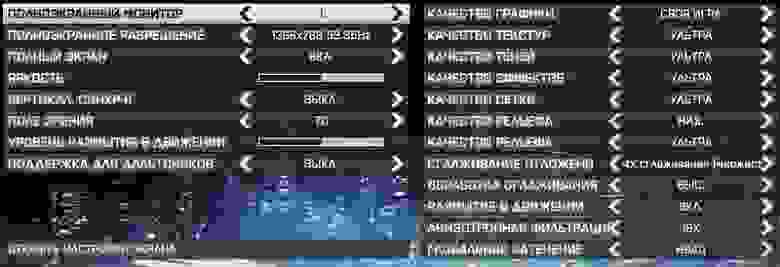

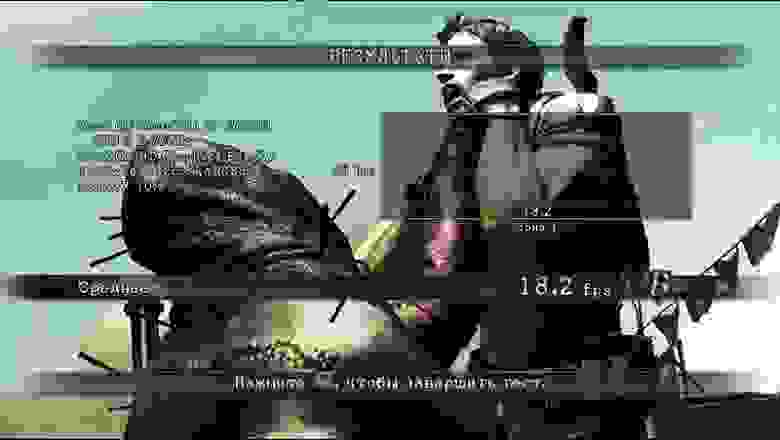

Следующим идёт «фиксированный тест» RE5. Настройки изображения выставлены на максимум, сглаживание х4 (поскольку интегрированное видео поддерживает только его, поэтому для GTX 670 значения будут такие же во всех тестах), V-Sync отключен (аналогично во всех тестах), разрешение 1366х768.

– Intel HD Graphics 3000 18,2 fps

– ZOTAC GeForce GTX 670 AMP! 74,6 fps

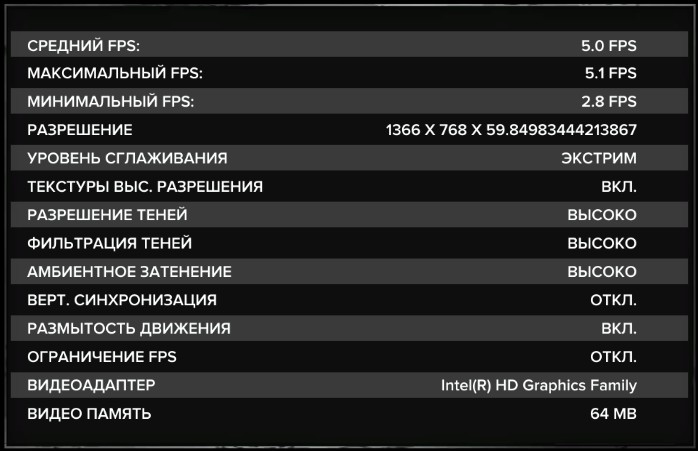

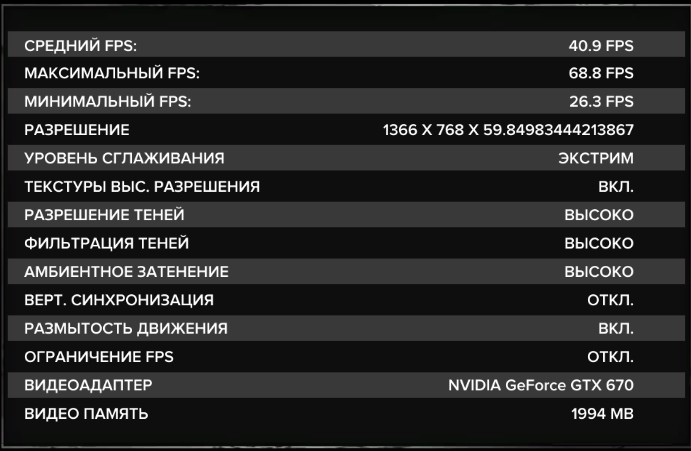

Sleeping Dogs – игра этого года. При соответствующих настройках графики, вполне сносно идёт даже на интегрированном видео, однако ситуация меняется кардинально если выставить всё по максимуму. Смотрим скриншоты:

– Intel HD Graphics 3000

– ZOTAC GeForce GTX 670 AMP!

Пришёл черёд тяжёлой артиллерии. Battlefield 3 – пожалуй, одна из самых ресурсоёмких игр на сегодняшний день. Очень жаль, что разработчики не включили в игру простенький бенчмарк, было бы очень кстати, пришлось использовать FRAPS. Для тестирования была выбрана миссия «Братья по оружию». Настройки для обоих видеоадаптеров следующие:

– Intel HD Graphics 3000 Min: 1fps — Max: 5fps

– ZOTAC GeForce GTX 670 AMP! Min: 30fps — Max: 93fps

Завершает цепочку программ для тестов игра Left 4 Dead 2 – адреналиновый экшн с кусками отлетающей плоти. При средних настройках, игра, довольно таки быстро, работает на встроенном видео, за исключением некоторых кампаний, таких как Swamp Fever, где наблюдаются небольшие лаги. Для теста была загружена начальная миссия кампании The Parish, которая относительно не требовательна к ресурсам. Были использованы следующие настройки:

Результаты, опять же, были получены с помощью FRAPS:

– Intel HD Graphics 3000 Min: 11fps — Max: 37fps

– ZOTAC GeForce GTX 670 AMP! Min: 48fps — Max: 101fps

Вот и подошло к концу моё небольшое тестирование eGPU системы. Честно признаюсь, впечатления самые наилучшие. Невозможно передать тот неописуемый восторг от того, что одним движением руки простой ноутбук может превратиться в рабочую станцию, а ведь при использовании внешнего монитора можно добиться ещё лучших результатов! И всё это, без каких либо ошибок, синих экранов и пр. Кроме того, все затраты на покупку комплектующих можно существенно сократить купив б\у или более дешёвые аналоги, ранние модели комплектующих и пр. А при наличии материалов, инструментов и прямых рук можно сделать eGPU адаптер и бокс к нему самостоятельно, благо на сайте производителя есть схемы. Более того, если вы постоянно переезжаете и при этом испытываете недостаток в мощности видеоподсистемы, то вам действительно стоит попробовать eGPU, ведь намного проще перенести ноутбук и разобранный eGPU, нежели чем полноценный, стационарный компьютер со всеми его клавиатурами, мониторами, системными блоками и прочей периферией.

— Дешевизна (если поставлена такая цель)

— Мобильность выше, чем у стационарной системы (можно даже в пластиковый чемоданчик всё сложить)

— Достаточная производительность, позволяющая запускать все современные игры на высоких настройках и разрешениях (в зависимости от видеокарты)

— Простота в сборке и подключении

— Возможность использования дисплея ноутбука.

— Возможно использовать другие PCI девайсы (например звуковую карту)

— Возможно подключение нескольких мониторов одновременно

— Рекомендуется использование видеокарт nVIDIA – с ними меньше мороки.

— FPS, получаемые при использовании монитора, выше, чем при использовании дисплея ноутбука.

— Ограниченность интерфейса PCI. Opt. 1.1 — 250 MB/s, Opt 1.2 — 500 MB/s (для систем на базе микроархитектуры Sandy Bridge и Ivy Bridge, при использовании видеокарт nVIDIA микроархитектур Fermi или Kepler)

— Обязательное использование стационарного блока питания для энергоёмких видеокарт (однако есть примеры использования eGPU с обычным внешним БП от Xbox первого поколения, который обеспечивает 203 ватт)

— Использование eGPU невозможно с некоторыми моделями ноутбуков

В нагрузку, я хотел бы порекомендовать для ознакомления несколько видео, показывающих работу eGPU системы:

Благодарности

Прежде всего, благодарю участников форума Techinferno АР27 и nando4 за молниеносные и доходчивые ответы на мои вопросы, сообществу eGPU пользователей было бы очень сложно без вас. Thank you guys!

Спасибо форумам Techinfreno и Notebookreview – это настоящие кладези IT информации о различных гаджетах и устройствах, здесь вы можете найти и получить ответы на любые интересующие вас вопросы.

Спасибо всем создателям eGPU адаптеров.

Спасибо и вам, уважаемые хабра-пользователи за то, что выкроили немного своего времени на прочтение моей статьи.

Ссылки

В статье были использованы материалы следующих сайтов:

forum.notebookreview.com – портал, посвящённый различным моделям ноутбуков и всем, что с ними связано.

www.3dmark.com – известная компания, выпускающая бенчмарки на протяжении многих лет.

console.hardocp.com – портал, посвящённый обзору различных комплектующих и их обсуждению.

www.pcworld.com – крупный портал посвящённый различным аспектам IT индустрии.

forum.techinferno.com – отличный портал, связанный с IT тематикой.

forum.techinferno.com/diy-e-gpu-projects/2109-diy-egpu-experiences-%5Bversion-2-0%5D.html – ветка посвящённая eGPU.

P.S.: Вот и всё. Цель данного поста – поделиться опытом. Надеюсь, хоть кому-нибудь было интересно. Готов ответить на любые вопросы касательно темы.

С момента покупки прошёл почти месяц. Решил дополнить свой обзор, а именно касательно тонкостей включения и выключения eGPU.

— При первом подключении вставляем адаптер в экспресс порт, включаем ноутбук. На данном этапе, происходит конфигурация системы и для eGPU выделяется диапазон свободной памяти.

— После того, как наигрались \ намоделировались и т.д., и работа eGPU не требуется, отключаем его через функцию «безопасное извлечение устройства» (всегда!).

— Если после работы за компьютером используется функция «спящего режима» или «гибернации», то после восстановления работы (или при повторном подключении eGPU без перехода в вышеописанные режимы \ перезагрузке \ выключении), напрямую подключаем eGPU и, через рабочий стол переходим к графическим функциям драйвера nVIDIA. Если есть вращающийся трёхмерный значок nVIDIA, то всё в порядке, если его нет и происходит постоянный крах драйвера, то извлекаем eGPU через функцию «безопасное извлечение устройства» и подключаем снова, смотрим значок (обычно случаи с крахом драйвера единичны).

— Если после работы компьютер выключается без использования функций «спящего режима» или «гибернации», необходимым условием работы eGPU при следующем запуске, является его подключение к ноутбуку до включения \ прохождения «POST» .

— В случае если, по не понятным причинам, не удаётся подключить ранее нормально работающий eGPU, попробуйте перезагрузить ноутбук, подключив eGPU к ноутбуку до прохождения POST, в моём случае это всегда помогает.

Несмотря на вышеописанные тонкости, ещё раз подчеркну, что я доволен как слон и ни капли не сожалею о своей покупке.

Источник