- Всё, что нужно знать про кодек Apple ProRes для видео в iPhone. Это вам не в Инстаграм снимать

- Что такое Apple ProRes

- Какие особенности и ограничения есть у ProRes на iPhone

- Как снимать в ProRes на iPhone

- Нужен ли ProRes в текущем поколении iPhone

- История развития форматов видеосжатия

- 1988 год – H.261

- 1993 год – MPEG1

- 1996 год – MPEG2

- 1998 год – MPEG4

- Новейшая история, год 2003 – H.264

Всё, что нужно знать про кодек Apple ProRes для видео в iPhone. Это вам не в Инстаграм снимать

На презентации новых iPhone 13 Pro купертиновцы показали новую возможность флагманов – съемку роликов в формате ProRes. Фишку не успели доделать к старту продаж моделей, она стала доступна лишь с выходом ключевого обновления iOS 15.1.

Опция стала большим шагом вперед в развитии мобильной видеосъемки. В свое время в Apple уже создавали подобные прорывные технологии для фото вроде портретной съемки в iPhone 7 Plus или Apple ProRAW в iPhone 12 Pro.

Сейчас разберемся, есть ли смысл записывать видео в ProRes на iPhone. Какие преимущества и перспективы у данного кодека в мире мобильной видеосъемки?

Что такое Apple ProRes

Apple ProRes – это не один, а целое семейство кодеков, которые используются для сжатия видео. Кодеки разработаны компанией Apple и впервые были представлены в одном из обновлений приложения Final Cut для Mac в 2007 году.

Кодеки ProRes основаны на дискретно-косинусном алгоритме преобразования данных и используют одновременно несколько методов сжатия видеопотока.

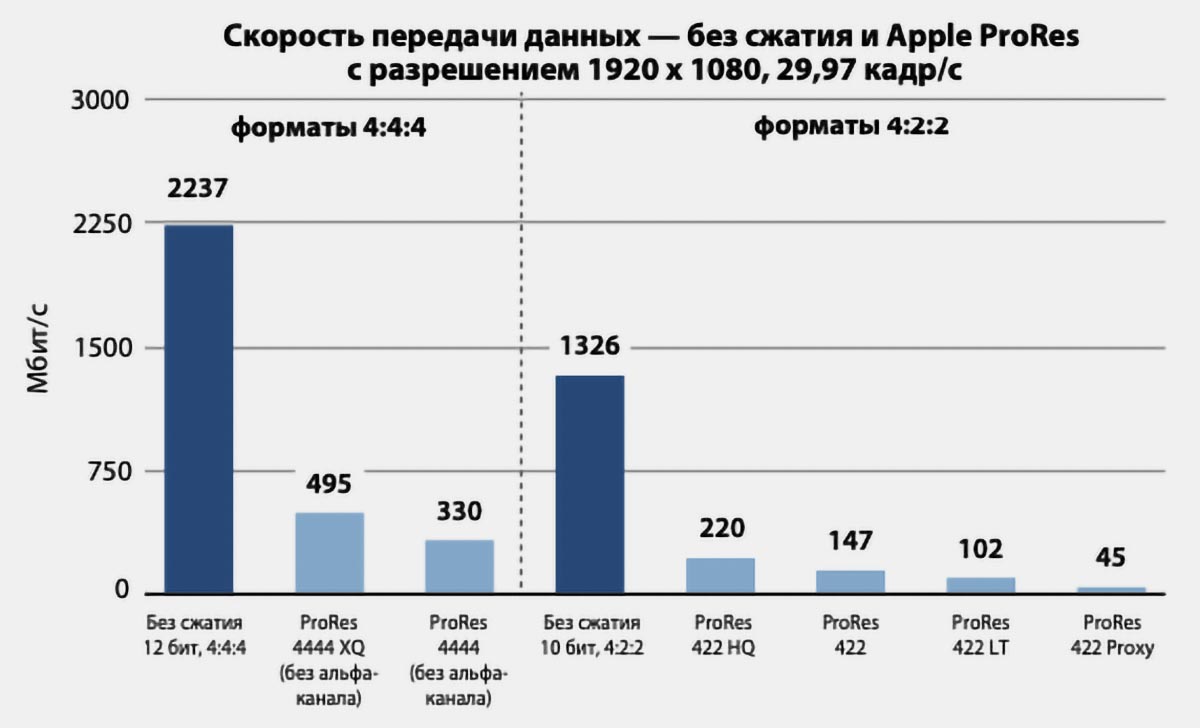

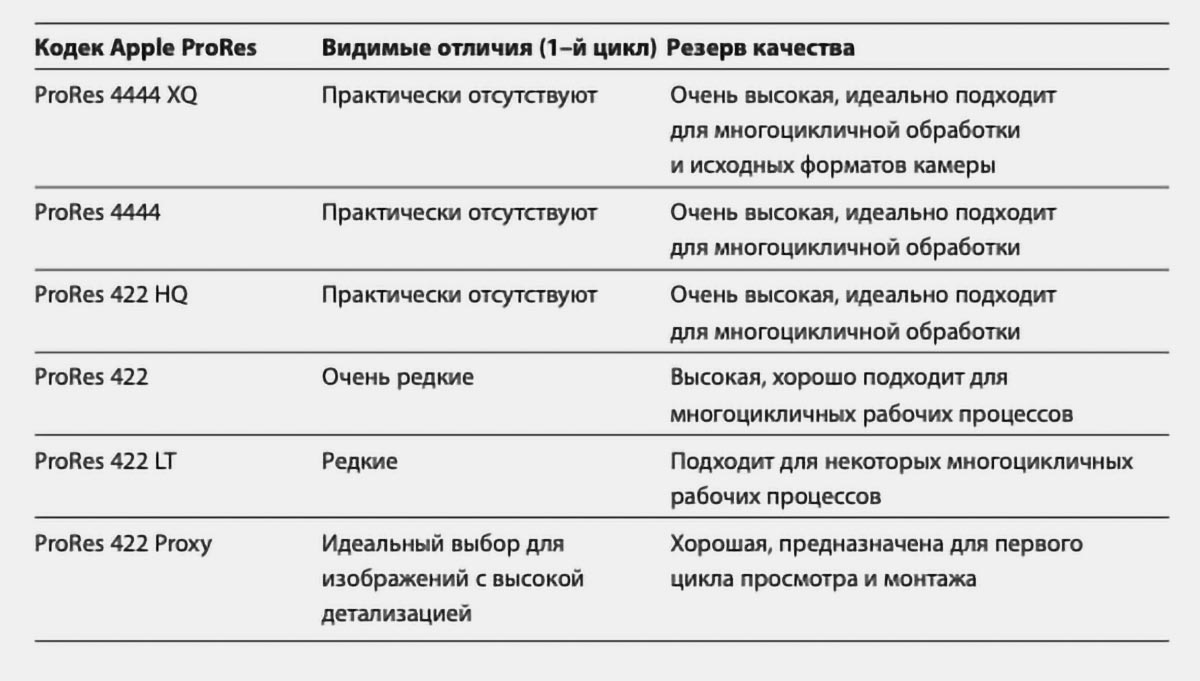

Есть несколько разновидностей кодека ProRes.

◉ Apple ProRes 4444 XQ: самый топовый 12-битный кодек без сжатия, который поддерживает высокую скорость видеопотока, широкий динамический диапазон и альфаканал.

◉ Apple ProRes 4444: это 12-битный кодек без сжатия, который поддерживает цветовые пространства RGB/Y’CrCb и умеет хранить данные о прозрачности (альфаканал).

◉ Apple ProRes 422 (HQ): это 10-битный кодек высокого разрешения (вплоть до 8К), который имеет более высокий битрейт и качество картинки.

◉ Apple ProRes 422: аналог предыдущего 10-битного кодека, но с более низким качеством картинки и скоростью видеопотока.

◉ Apple ProRes 422 (LT): еще более облегченный вариант 10-битного кодека, который балансирует на грани качества картинки и размера исходного файла.

◉ Apple ProRes 422 (Proxy): кодек с довольно низкой скоростью видеопотока, который в основном используется для чернового монтажа.

Основные отличия и предназначения разных видов кодека ProRes

Семейство кодеков Apple при полной поддержке программной и аппаратной платформ обеспечивает быструю и удобную работу с видеоматериалом. Данные в ProRes практически не требуют ресурсов устройства для распаковки, что ускоряет процесс монтажа. Особенно это заметно при работе с несколькими потоками одновременно.

Кроме того, ролики в ProRes хранят большой объем информации о цвете, как и фотографии в ProRaw, позволяя на стадии монтажа вытягивать слишком темные или, наоборот, засвеченные участки кадра.

Расплатой за эти преимущества является размер файлов, отснятых в ProRes.

Купертиновцы продают лицензии на кодирование и декодирование в кодек ProRes, благодаря чему он стал довольно популярным форматом хранения данных. Определенные камеры производителей Blackmagic, Canon, DJI, Panasonic, Sony и других умеют сохранять отснятый материал в ProRes.

Полный список производителей и моделей камер с поддержкой Apple ProRes можете просмотреть здесь.

Осенью 2021 года к списку поддерживаемого оборудования добавились смартфоны Apple.

Какие особенности и ограничения есть у ProRes на iPhone

Чтобы научить мобильный гаджет сохранять видео в профессиональном, удобном для последующей обработки формате, купертиновцам пришлось пойти на ряд ухищрений.

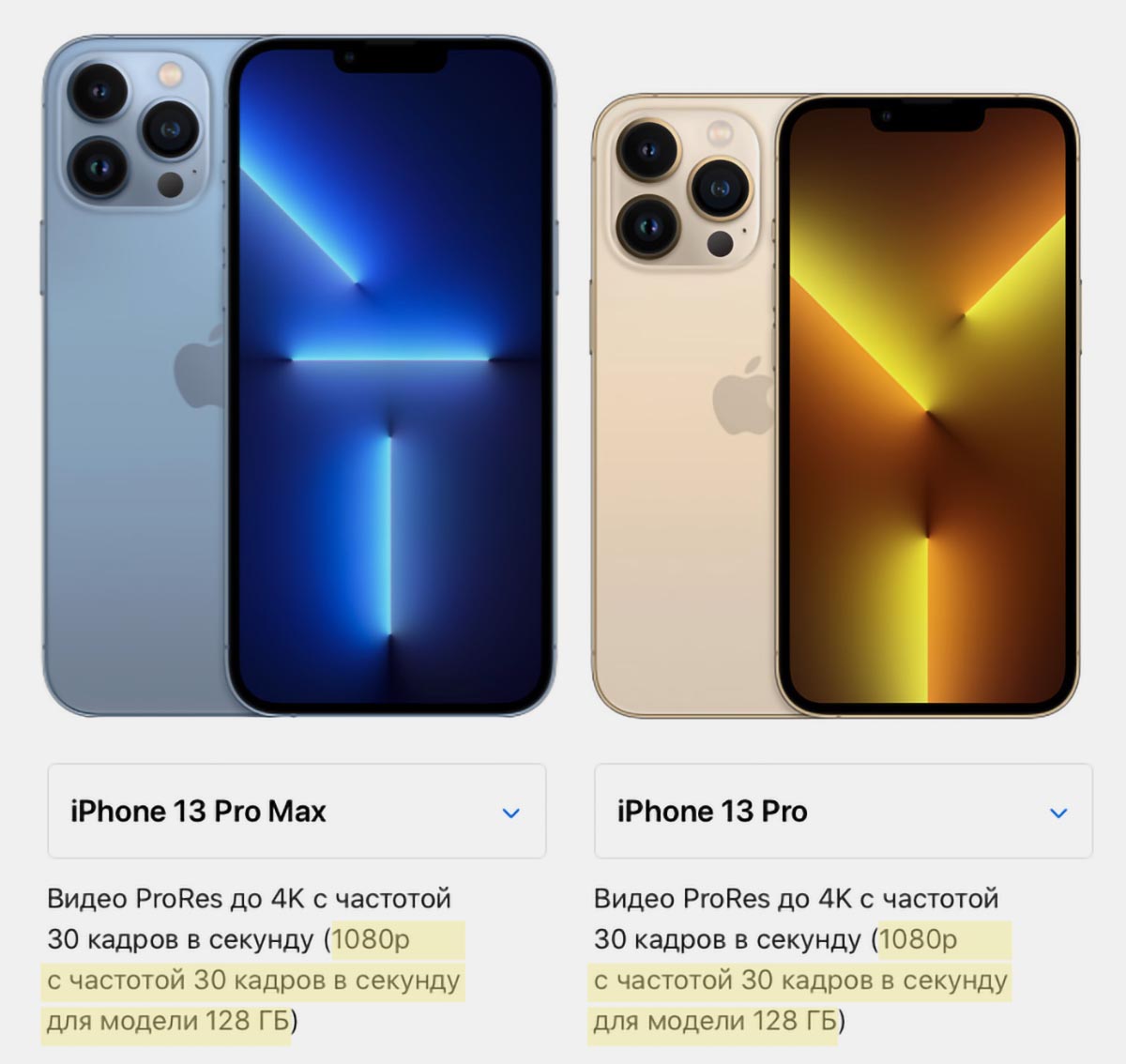

Во-первых, кодек ProRes поддерживается только в моделях iPhone 13 Pro и iPhone 13 Pro Max .

Во-вторых, как уже было сказано выше, видео в формате ProRes занимают очень много места на устройстве . Минутный ролик в 4K разрешении будет занимать около 6 ГБ. Из-за этого в Apple ограничили максимально доступное разрешение для съемки в ProRes на моделях iPhone 13 Pro с минимальным объемом памяти.

Накопителя на 128 ГБ могло бы хватить для сохранения всего 18-19 минут видео в ProRes 4K. Базовая “прошка” умеет снимать ProRes в разрешении 1080p. Смартфон Apple с максимально возможным объемом памяти в 1 ТБ способен уместить чуть более 2.5 часов видео в ProRes с разрешением 4K.

В-третьих, отснятый материал в ProRes рано или поздно придется передавать на компьютер для дальнейшей обработки и монтажа . А здесь все упирается в старый добрый Lightning, который явно выбивается из «профессиональной» направленности iPhone 13 Pro.

Стандартный разъем iPhone, который не менялся с 2012 года, позволяет передать около 3.5 Гб данных в минуту. Это значит, что минутное видео в ProRes будет передаваться около 3 минут, а часовой ролик – почти 3 часа!

В-четвертых, ProRes поддерживают не все устройства Apple . Соответственно, при передаче данных по AirDrop ролики могут быть автоматически перекодированы в H.264 или HEVC.

Это нужно помнить при попытке перебросить большой объем данных по воздуху.

Передать ProRes без конвертации можно на такие устройства:

◈ Всю линейку iPhone 13 (включая модели iPhone 13 mini и iPhone 13);

◈ iPad mini (6-го поколения);

◈ iPad Pro (11″ всех поколений или 12.9″ 3-го поколения и новее);

◈ Компьютеры Mac с OS X 10.6 и новее.

Эти устройства смогут сохранять ProRes без перекодирования, просматривать и редактировать видео.

В-пятых, изначально флагманские модели iPhone снимают с использованием кодека Apple ProRes 422 (HQ). Это один из трех видов кодека без сжатия, но, в отличие от ProRes 4444 и ProRes 4444 XQ, он не умеет хранить данные об альфаканале и записывает до 10 бит.

Сторонние приложения для съемки видео позволяют активировать кодеки со сжатием: ProRes 422, 422 (LT) или 422 (Proxy).

Как снимать в ProRes на iPhone

Работает данная фишка только на моделях iPhone 13 Pro и iPhone 13 Pro Max с установленной операционной системой iOS 15.1 и новее.

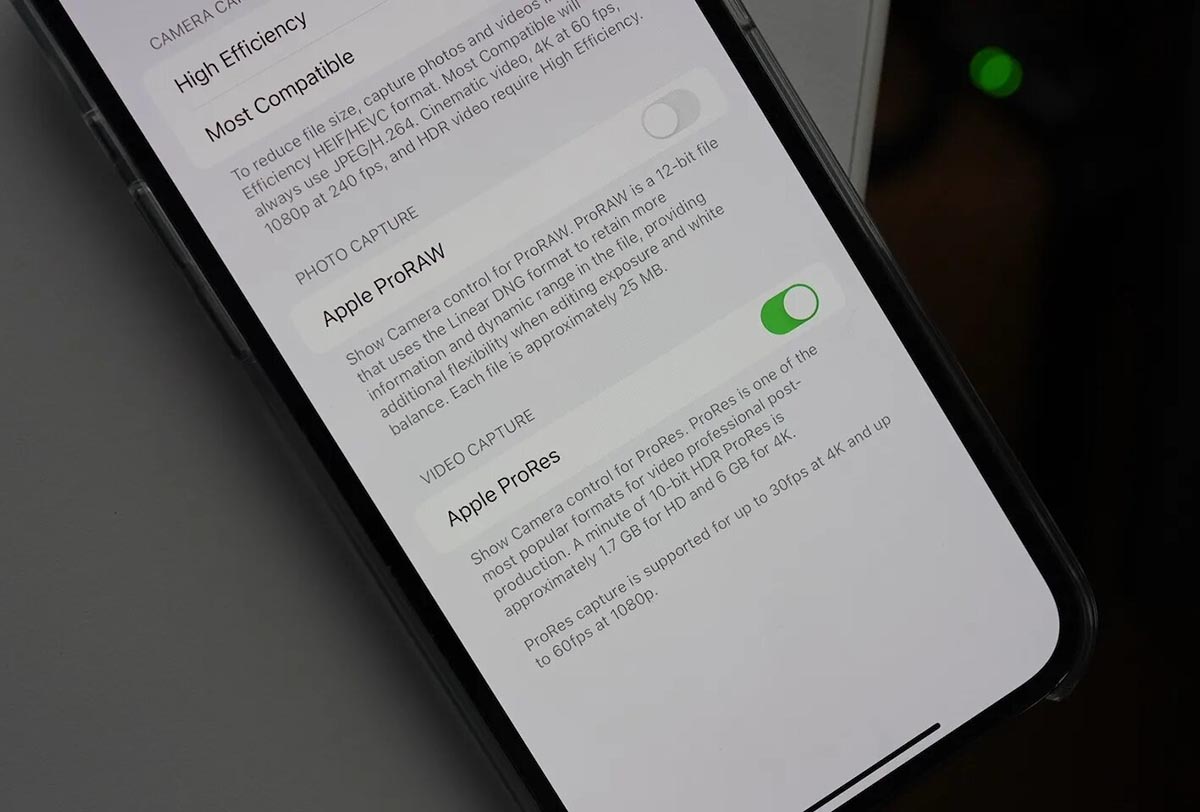

1. Перейдите в Настройки – Камера – Форматы.

2. Активируйте переключатель Apple ProRes в разделе Видеосъемка.

3. Включите приложение Камера в режиме съемки Видео и активируйте кнопку ProRes в верхней панели.

Обратите внимание, что съемка в ProRes невозможна в режиме «Киноэффект», при замедленной съемке или покадровом режиме.

Видеоролики могут быть сняты в разрешении 1080p 25/30/60 кадров в секунду или 4K 24/25/30 кадров в секунду.

Не забывайте, что модели с минимальным объемом памяти не могут записывать ProRes ролики в 4K.

Съемка в ProRes в приложении FiLMiC Pro

Здорово, что купертиновцы не стали ограничивать работу с ProRes исключительно встроенным приложением Камера. Снимать в «яблочном» формате можно и при помощи сторонних программ.

Например, такая возможность появилась в одном из последних обновлений FiLMiC Pro.

Нужен ли ProRes в текущем поколении iPhone

В Apple каждый год стабильно улучшают камеру новых флагманских моделей iPhone. В этом году кроме апгрейда железа купертиновцы сделали большой шаг вперед в плане программного обеспечения для съемки видео.

Новые модели iPhone 13 Pro получили поддержку кодека ProRes, но выглядит это новшество не сиюминутным бонусом, а фишкой на перспективу.

Сейчас даже при самом пристальном сравнении найти отличие между снятыми с использованием разных кодеков роликами найти непросто. Многократное увеличение, попытка найти различия в динамических сценах, агрессивная цветокоррекция или перекраска кадра пока не позволяют выявить серьезные плюсы роликов в ProRes.

Матрица iPhone еще не способна предоставить такой большой объем информации и данных, чтобы был смысл кодировать ее в профессиональный видеокодек .

Наглядное сравнение видео в ProRes и HEVC. Найдите 10 отличий.

Через два-три года, когда матрица и используемая оптика пройдут еще несколько стадий эволюции, мы обязательно получим профит от ProRes кодека в iPhone.

А пока, если вы не суперпрофессионал, использовать ProRes в текущем поколении «прошек» нет особой необходимости. Вы быстрее заполните память смартфона, а затем потратите больше времени на передачу контента на компьютер для дальнейшей обработки.

Источник

История развития форматов видеосжатия

Далёкий 1988й год был полон удивительных событий. В этом году увидел свет 4й альбом группы Metallica «. And justice for all», а СССР запустил в свой первый и единственный полёт многоразовый космический корабль «Буран». В этом же году началась история видеосжатия – появился самый первый стандарт видео-кодека.

Самые известные стандарты видеосжатия появились благодаря двум конторам: VCEG и MPEG . Нельзя назвать их конкурентами: некоторые стандарты были выпущены комитетами поодиночке, некоторые стали плодом их запретной любви коллективной работы в составе объединённых групп. По иронии судьбы именно эти «совместные» форматы и получили наибольшее распространение.

1988 год – H.261

1993 год – MPEG1

В 1993 появился MPEG1. Революционным нововведением в формате MPEG1 стали B(ipredicted) кадры. Т.е. кадры могли теперь предсказываться не только от предшествующего опорного кадра, но и последующего. Появились полупиксельные вектора движения, что позволило поднять точность предсказания и тем самым повысить качество. Было введено понятие «слайс» (Slice) – часть кадра (группа макроблоков), которая кодируется независимо от других слайсов. Стало возможным сжимать разные части кадра с разными параметрами, но, самое главное, в MPEG1 появилась поддержка очень больших разрешений, вплоть до 4К на 4К.

По непонятной причине, комитет MPEG выкинул из стандарта этап де-блокинга. Комитет даже не убедило существенное повышение качества, достигнутое при использовании де-блокинга в стандарте H.261. Скорее всего, решение было основано на данных о типичной производительности микропроцессоров того времени. В отличие от H.261, стандарт MPEG1 состоял из нескольких частей, описывающих всё необходимое для полноценного цифрового видео: аудио сжатие, видео сжатие, хранение и синхронизация аудио-видео данных, средства тестирования совместимости и референсный декодер для отладки.

В начале девяностых годов в компании Intel, да и вообще в компьютерной индустрии, вряд ли существовало полное понимание того, какое влияние в будущем окажет видеокодирование на архитектуру процессоров. Это много позже сжатие и разжатие цифрового видео стало коньком компании. А пока, в марте 1993, начал свою долгую жизнь один из самых известных процессоров компании Intel – Pentium. В нем не было ничего особенного для ускорения видео-обработки, разве что одинокая инструкция bsr (bit scan reverse). Эта инструкция осталась еще со времён 386го процессора и могла быть использована для ускорения декодирования Хаффмана. Производительности Pentium’а хватало, чтобы тихонько декодировать H261 формат. Но без звука :). Надеюсь, некоторые читатели еще помнят, как икал winamp, если пошевелить мышкой.

1996 год – MPEG2

1996 год. Опубликован стандарт MPEG2. Совсем скоро разойдутся по планете миллионными тиражами DVD диски, которые сделают MPEG2 первым широко распространенным форматом на многие годы. MPEG2 практически не принёс ничего нового в процесс сжатия, за исключением черезстрочного видео, поддержки нескольких форматов аудио-сжатия и дополнительных цветовых разрешений. MPEG2 не был оптимизирован для использования на маленьких (меньше 1мбит) потоках. Зато на бОльших потоках MPEG2 уверенно превосходил MPEG1, а сам стандарт разросся до 11 частей.

Технология MMX состояла из набора дополнительных 57 инструкций и 8 новых 8ми-байтных регистров. Существенное ускорение (до 3х-4х раз) достигалось за счёт одновременной обработки инструкцией нескольких данных. В этом плане цифровое видео стало идеальным полем для внедрения новой технологии. На MMX возлагали большие надежды, и даже поместили на официальное лого процессора.

Чуть позже в этом же году вышел процессор Pentium II, который за счёт своей суперскалярности, большого кэша, шустрой шины и нового типа памяти сделал доступным просмотр DVD на персональном компьютере.

1998 год – MPEG4

MPEG4, появившийся в 1998 году, достаточно быстро завоевал себе славу «пиратского» формата. Кодек DivX, использующий MPEG4 формат, произвёл настоящий фурор. DivX позволял с приемлемой потерей качества сжимать MPEG2 DVD диск в файл размером с CD диск. Я помню, как многие мои друзья кинулись пережимать DVD фильмы (откуда они их брали. ) и делать свою личную коллекцию DivX фильмов.

Успех формата MPEG4 состоял из нескольких слагаемых: вектора движения стали четверть-пиксельными, что позволило поднять точность предсказания, макроблок мог содержать уже до 4 векторов движения, что было полезно на границе движущихся объектов, и (фанфары!) вернулся незаслуженно уволенный пять лет назад де-блокинг.

Разработчики стандарта добавили в MPEG4 ещё одну интересную вещь: intra-предсказание. Теперь макроблоки в I-кадрах могли «предсказываться» от соседних макроблоков, что существенно снижало размер intra макроблоков в кадрах со сложной, но повторяющейся структурой.

К сожалению, сам стандарт сжатия, а вернее его чрезмерные способности, не нашли горячего отклика в лице производителей кодеков. Многие прогрессивные фишки MPEG4, такие как 3D видео текстуры, несколько видеоплоскостей в кадре и прочее, остались невостребованными.

Новейшая история, год 2003 – H.264

Год 2003 можно смело назвать эпохальным годом в истории развития форматов видеосжатия: появилась альфа и омега сегодняшнего цифрового видео — стандарт H.264. Новый стандарт был полностью целочисленным, т.е. все этапы декодирования видео выполнялись в целых числах, благодаря чему была достигнута побитовая идентичность видео при декодировании декодерами разных производителей.

От предков H.264й отличался продвинутым intra-предсказанием макроблоков, различным разбиением макроблоков при компенсации движения (от 4×4 до 16×16), 6ти точечным фильтром компенсации движения, продвинутым арифметическим сжатием энтропии, наличием долго-хранящихся опорных кадров, гибким управлением опорными кадрами, 16 векторами на макроблок, всеми доступными цветовыми разрешениями, 8мью и более битами на компонент цвета и множеством других волшебных фишек. Стандарт не только оставил далеко позади всех конкурентов, но и установил новые требования к производительности процессора. Теперь, чтобы проигрывать видео в формате HD, одного процессора (даже с технологией HyperThreading) уже недостаточно.

Период 2003-2005 годов был тяжёлым для пользователей, которым не хватало производительности, но золотым временем для оптимизаторов ПО. Их услуги были на расхват! Производительность ЦПУ явно была в дефиците, и с этим надо было что-то делать. В мае 2005 решение пришло – впервые со времён процессора Pentium III многоядерность вернулась в пользовательские машины. Процессор Pentium 4 с кодовым названием Smithfield гордо нёс свои 2 ядра в массы. На самом деле, компания Intel слукавила – это были 2 «почти» обычных процессора Pentium 4, расположенные на одной подложке. Процессоры могли общаться друг с другом исключительно через шину FSB, не могли «подглядывать» соседу в кэш. Тем не менее, производительности Smithfield’а было достаточно, чтобы на лицах пользователей снова засветилась улыбка. Покупайте попкорн, занимайте места в «зрительном» зале. Только благодаря многоядерности в многолетней битве между процессорами и форматами цифрового видео наметился перелом: процессоры стали способны декодировать цифровое видео в любом формате, в любом разрешении с комфортной для зрителя скоростью. Но это был лишь выигранный бой, но не сражение.

Как мы знаем, цифровое видео можно (и нужно) не только ДЕкодировать, но и в первую очередь кодировать. А вот с этим всё было не так радужно, как того бы хотелось. Для полноценного, быстрого и качественного сжатия видео современных процессоров хватало разве что на стандартное разрешение формата MPEG2/MPEG4, не более.

Однако, как уже было замечено, появление многоядерности принесло победу в бою, но не в сражении. Осенью 2007 года объединённая группа комитетов наносит ответный удар в виде нового профиля масштабируемого сжатия к стандарту H264 Scalable Video Coding (SVC). Сложность кодирования и декодирования возрастает в разы. Это был не полноценный стандарт, а всего лишь настройка над существующим, основная задумка которого – существенное повышение качества видео, передаваемого по сетям с потерями. Теперь в видео потоке один и тот же фильм мог храниться в разных разрешениях, и более высокие разрешения использовали более низкие в качестве опорных. У такого решения был ещё один дополнительный плюс: теперь устройства, которые не нуждалось в HD качестве фильма, могли декодировать только часть потока с необходимым разрешением.

Но ничто уже не могло поменять ситуацию в обратную сторону. Компания Intel в начале 2008 закрепляет свой успех выходом процессора на ядре Penryn с новыми инструкциями SSE4.1. Как скажут позже – это было самое большое SIMD расширение со времён процессора Pentium III. Тут были и абсолютно новые инструкции, заточенные на кодирование цифрового видео, и новые расширения для уже существующих SIMD инструкций. Кодирование HD видео в формате H264 уже уверенно движется в реальном времени с приемлемым качеством.

Вышедший в ноябре 2009 новый профиль для кодирования видео снятого с нескольких точек для формата H264 Miltiview video coding (MVC) не мог ничего изменить. Новый профиль не добавлял ничего нового, просто описывал правила и способы организации битового потока для сжатия видео снятого с нескольких камер. Не смотря на то, что производительности процессоров 2009 года не хватало, чтобы сжимать подобное видео в реальном времени, это был вопрос одного, максимум двух поколений процессоров.

В 2002 году я разговаривал с одним своим коллегой насчёт оптимизации и мультимедиа-ориентированности современных процессоров (как вы помните, время господства технологии SSE2). И на какой-то мой довод коллега ответил, что процессоры станут мультимедиа-ориентированными только тогда, когда там появится инструкция idct. Могли ли мы предположить в далёком 2002, что спустя всего 9 лет жизнь оправдает гораздо более смелые планы и ожидания?

Теперь сжатие видео для любимого iPad – не проблема. HD сериал из 24 серий по 20 минут кодируется за 20 минут. Фильм на 1.5 часа кодируется за 5 минут. Больше не надо тратить своё время и оставлять компьютер включенным на ночь. Достаточно просто сходить и налить чай. Процессоры победили.

PS: На этом я хотел бы закончить своё повествование, но это было бы лукавством. В воздухе опять пахнет бурей. Дело в том, что объединенная группа комитетов разрабатывает следующий стандарт сжатия цифрового видео – High Efficiency Video Coding (HEVC). HEVC будет нести в себе лучшие качества H264 формата, но при этом будет обладать огромным количеством новых особенностей и возможностей, которые предъявят повышенные требования к ЦПУ. И борьба между стандартами видеосжатия и процессорами может выйти на новый виток. И так до бесконечности.

Upd. В предпоследнем абзаце шла речь про пересжатие HD видео для определённого гаджета — iPad. Извиняюсь, что упустил этот момент.

Upd2. Хабровчане, будем чуть дружелюбнее и рассудительнее. Я уверен, что со временем программные средства развивались, и некоторые негативные эффекты, описанные в статье, со временем прошли. Например, winamp перестал «икать» на медленных процессорах.

Источник