108 мегапикселей — прорыв или провал? Как на самом деле работают камеры iPhone, Samsung и Huawei

На этой неделе компания Samsung представила трио флагманских смартфонов Galaxy S20. Старшая модель получила камеру с разрешением 108 Мп. У многих при виде такой цифры наверняка округлятся глаза. А кто-то и вовсе брезгливо посмотрит на свой последний iPhone с 12 Мп. И зря. Ведь количество мегапикселей — не главный показатель. Про то, что важно на самом деле, рассказываем ниже.

Давайте по порядку. Разрешение фотографии — это количество пикселей на полотне. Камера с разрешением 48 Мп делает полотно с 48 миллионами цветных кубиков. Камера с 64 Мп даёт полотно с 64 миллионами точек, а сенсор с 108 Мп — 108 миллионов.

Единственная польза от количества пикселей — это количество объектов, которое рисует на полотне изображение. Последнее влияет на детализацию. То есть на 12-мегапиксельном снимке при приближении можно разглядеть меньше мелких объектов, чем на снимке в 108 Мп.

Так это ведь самое важное?

Нет. Самое важное в мобильной камере — количество сценариев, при которых она окажется полезной. «Много пикселей» не равно «много сценариев». Главным фактором, влияющим на гибкость камеры, является свет. Его либо много, либо мало. Чем больше света, тем лучше фотография. «Лучше» — значит чётче, с хорошим динамическим диапазоном и правильным балансом белого. Поэтому многопиксельные камеры сильно зависят от количества света.

Чем больше пикселей, тем они, как правило, меньше. А это плохо. Представьте, что пиксель — это маленькое полотно, в которое врезаются фотоны, частицы света. Если пиксель большой — в него попадает много фотонов. Если маленький — мало.

Как следствие, при идеальном свете 108-мегапиксельные снимки будут однозначно хорошими. А вот при плохом — нет. Потому что маленькие пиксели получают мало света или не получают вовсе. Результатом дефицита света являются шумы на снимках. Шумы — это зернистость фотографий, наличие пикселей неправильного цвета.

108 Мп Xiaomi Mi Note 10. Фото © Фото © LIFE / Татьяна Руденко

В 108-мегапиксельной камере пиксели обязаны быть маленькими. Потому что их нужно расположить на матрице мобильной камеры. Последняя априори не может быть большой, потому что в смартфоне все компоненты упаковываются очень плотно.

То есть нужна просто большая матрица?

И (или) большие пиксели. Что такое матрица фотоаппарата? Матрица — это микросхема со светочувствительными фотодиодами, пикселями. Фотодиод под действием света создаёт электрический сигнал, который впоследствии преобразуется в цифровой сигнал. Он поступает в процессор, который уже задаёт пикселям нужные цвета, после чего получается изображение.

И как определить размер сенсора и пикселя в камере смартфона?

О, это задача нетривиальная. Потому что производители смартфонов предпочитают не оглашать эти параметры, если там нечем хвалиться. Впрочем, двумя годами ранее ситуация во флагманском сегменте начала меняться в лучшую сторону. Huawei со своими P20 Pro и P30 Pro навязала конкуренцию остальным вендорам и в размерах сенсоров.

Вопреки неразговорчивости брендов в большинстве случаев размеры сенсоров всё же узнать можно. Дело в том, что сегодня есть два поставщика фотоматриц на рынке смартфонов — Samsung и Sony. А уж в презентациях этих компонентов разработчики раскрывают все параметры, включая размеры матрицы и пикселя.

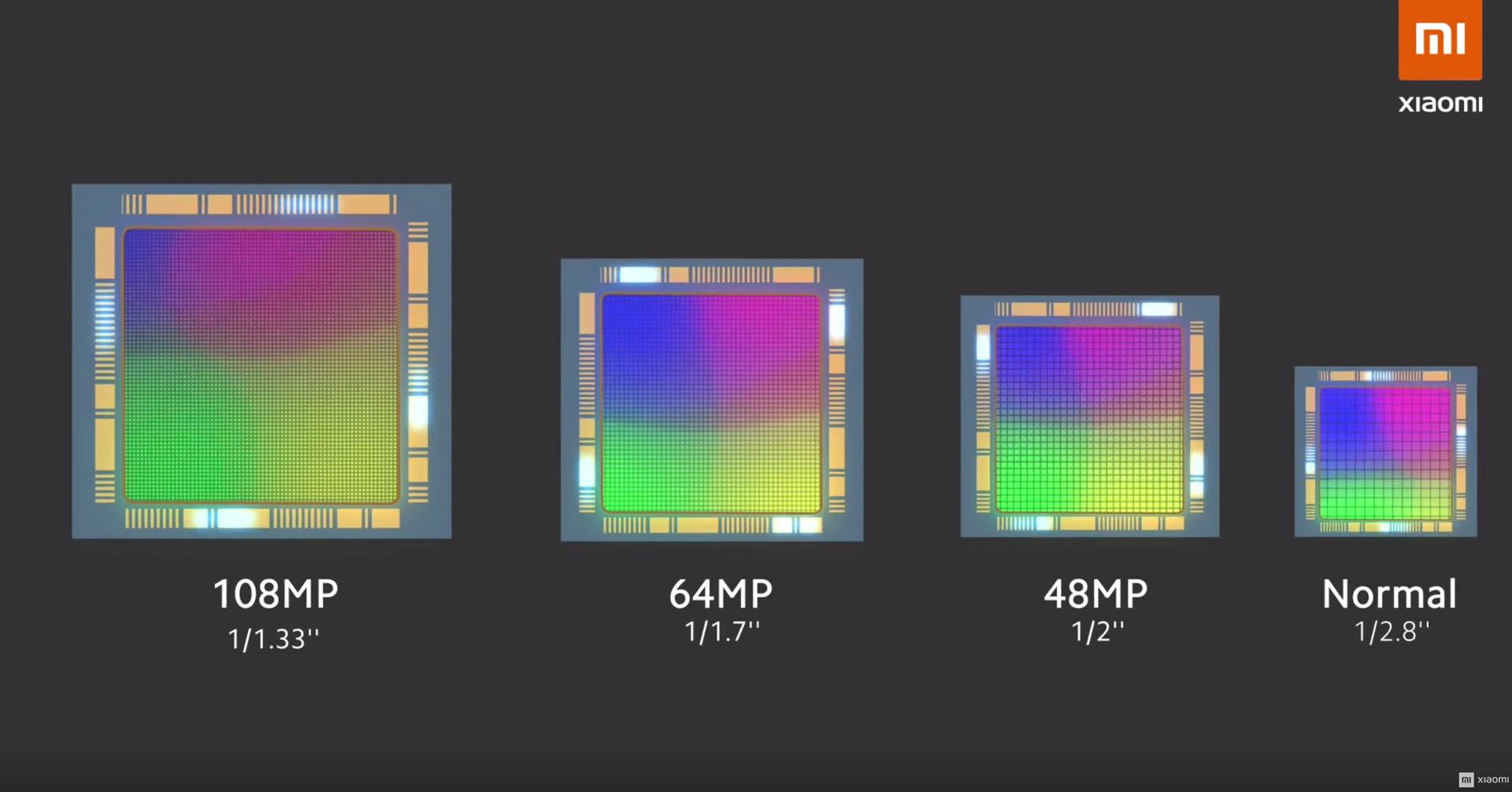

Размер матрицы — это диагональ светочувствительного сенсора, которая указывается в так называемых видиконовых дюймах. Последние вычисляются по специальной формуле, не зная которой, в числовых значениях можно запутаться довольно просто. Как бы там ни было, мы перевели для вас в нормальные миллиметры диагонали самых популярных на рынке мобильных матриц.

Если на крышке смартфона из Поднебесной красуется надпись 48MP, с вероятностью на 90% речь идёт о камере Sony IMX 586. Этот сенсор используется как в бюджетниках вроде Redmi Note 7 Pro, так и в условных флагманах типа OnePlus 7. Её размер — 1/2″, или примерно 8,4 мм. Размер каждого из 48 Мп — 0,8 микрометра (мкм).

Всю нишу 64-мегапиксельных сенсоров занял сенсор Samsung ISOCELL Bright GW1. Он используется в основном в устройствах среднего ценового сегмента вроде Realme XT и Vivo NEX 3. И физический размер уже 1/1,72″, или примерно 9,8 мм. При этом размер пикселя такой же, как Sony IMX 586, — 0,8 мкм.

Теперь перейдём к Huawei. Эти ребята используют матрицы Sony. В Mate 30 Pro стоит сенсор IMX 608 с номинальным разрешением 40 Мп и размером 1/1,54″, или примерно 12 мм. Размер пикселя, по разным данным, от 1,15 мкм.

В iPhone 11 используется классический 12-мегапиксельный сенсор от, скорее всего, компании Sony. Сама Apple не раскрывает эту информацию. Впрочем, как и Huawei. За них проблему решают разборщики. Тем не менее известно, что размер сенсора равен 1/2,55″, или примерно 6,7 мм. Да, матрица маленькая, зато размер пикселя — 1,4 мкм.

А теперь посмотрим на датчик Galaxy S20. Он называется Samsung ISOCELL Bright HM1. Размер — 1/1,33″, или примерно 12,7 мм. ISOCELL Bright HM1 — самый большой на сегодня мобильный сенсор в мире. Но! Истинный размер пикселя при этом всё равно остаётся маленьким — 0,8 мкм.

То есть камера Samsung заочно плохая?

Только с точки зрения физики. Хоть физические параметры важны, не менее ценно и программное обеспечение, которое обслуживает датчик. ПО можно условно поделить на две категории: алгоритмы первичной обработки изображения и алгоритмы постобработки.

Первые отвечают за то, чтобы информация, которая попадает на сенсор, для начала просто сложилась в корректное изображение. Вторые нужны для улучшения снимка, наложения эффектов. Так вот, сейчас — про первичные алгоритмы.

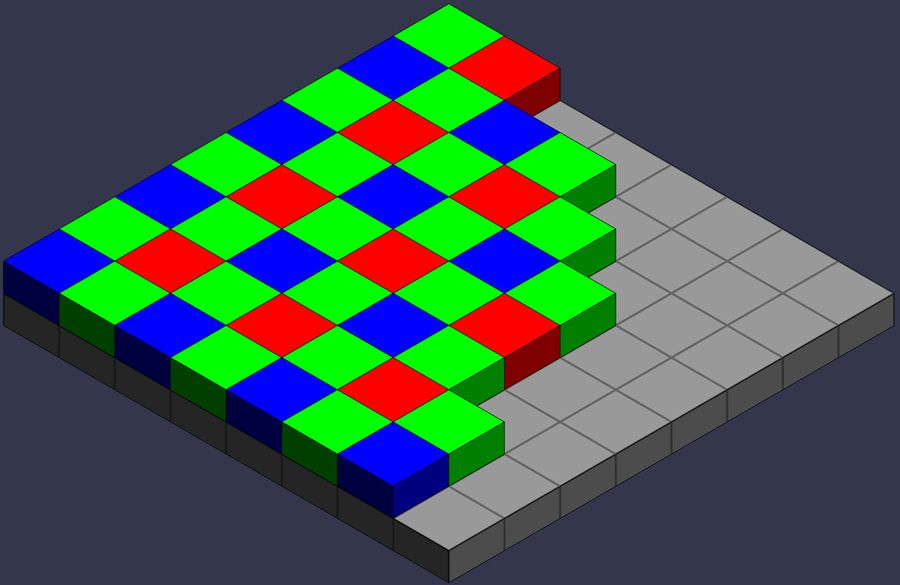

Самых важных два. Первый — фильтр Байера. Он назван в честь Брайса Байера, изобретателя алгоритма. Нужен для раскраски изображения, полученного с цифровой матрицы. Ведь по умолчанию они собирают монохромное изображение из пикселей, которые «поймали» свет и которые не поймали.

Фильтр Байера. Фото © Wikipedia

Фильтр Байера берёт ячейку из четырёх монохромных пикселей (2 х 2) и раскрашивает одну точку красным, одну точку синим и две — зелёным. Такой фильтр называется RGGB (Red, Green, Green, Blue). Зелёный доминирует, потому что он якобы лучше и приятнее для трихроматического зрения человека. Но это, судя по всему, условность, поскольку существуют и другие комбинации. Huawei, например, предпочитает RYYB (Red, Yellow, Yellow, Blue). Так снимки получаются теплее и светлее.

Второй алгоритм отвечает за разделение исходного изображения на большие или маленькие пиксели в зависимости от сценария съёмки. Помните про размер пикселя 0,8 мкм? Так вот, Samsung и Sony придумали программы, которые искусственно увеличивают пиксели.

У корейцев их уже два — Tetracell и Nanocell. Первый склеивает истинные пиксели размером 0,8 мкм в большой цифровой пиксель размером 1,6 мкм. Второй работает аналогично, но превращает маленькие истинные пиксели с цифрой на 2,4 мкм. Японцы пока что носятся только с алгоритмом Quad Buyer, который по аналогии с Tetracell превращает 0,8 мкм в 1,6 мкм.

Из-за этих алгоритмов все 40-, 48-, 64- и 108-мегапиксельные смартфоны по умолчанию снимают фотографии с разрешением 10 Мп, 12 Мп, 16 Мп и 27 Мп соответственно.

Сложно. Просто скажите, что всё это значит для простого пользователя

Это значит, что снимки всех многопиксельных смартфонов автоматически проходят мощную цифровую обработку на первичном этапе формирования изображения. С одной стороны, это хорошо. Samsung и Sony уверяют, что синтетическое увеличение пикселей — это благо, которое позволяет получать более светлые снимки в условиях плохой освещённости. С другой — плохо. Поскольку склейка пикселей не всегда проходит гладко. Нет-нет, но на снимках можно обнаружить артефакты в виде неправильной текстуры кожи, смазанной кирпичной кладки здания или кроны деревьев.

А что же со съёмкой в 108 Мп?

Фото © Long Wei / VCG via Getty Images

С суперразрешением ситуация комичная. Дело в том, что съёмка в 108 Мп (или 40, 48, 64 Мп) требует включения отдельного режима в интерфейсе смартфона. Причём зачастую нужная кнопка прячется в дебрях настроек. Такое решение является либо следствием невостребованности режима, либо умышленным огораживанием его от пользователя.

И то и другое легко объяснить. Потому что в разрешении от 40 до 108 Мп фотографировать бессмысленно. Во-первых, в этом режиме отключаются все вспомогательные алгоритмы: HDR, боке, ночная съёмка и не только. Как следствие, снимать остаётся лишь пейзажи при идеальном свете. Во-вторых, даже при съёмке в искусственных 27 Мп смартфон Xiaomi Mi Note 10 рендерит изображение две-три секунды. Это немного, но любая задержка в фотосессии — это плохо. При съёмке в 108 Мп смартфон замирает дольше. Процессор захлёбывается в обработке гигантского массива данных. В-третьих, по причине всё ещё большого количества входящей информации затвор камеры срабатывает медленно. Поэтому желательно фотографировать со штативом.

На все три критерия обычному пользователю просто чихать. Он хочет достать смартфон, нажать кнопку и получить красивый снимок. Без танцев с бубном.

О, iPhone хорошо фоткает без танцев с бубном!

Фото © Leon Neal / Getty Images

Вообще, существует убеждение, что, чем больше обработок (особенно на раннем этапе формирования) проходит изображение, тем оно дальше от истинного. Это тонкая грань, поскольку в таком случае очень легко свалиться в субъективизм как какому-нибудь воинствующему аудиофилу, который прогревает наушники перед прослушиванием FLAC. Однако в мире мобильных фотографий всё же есть объективные причины согласиться с высказыванием выше.

Осенью прошлого года полки магазинов трещали от обилия 48-мегапиксельных и даже 64-мегапиксельных смартфонов. На что Apple и Google ответили анонсами 12-мегапиксельных камер. Идиоты, что ли?

Вовсе нет. Во-первых, в обоих случаях размер пикселя у матриц почти вдвое выше, чем у конкурентов. Как следствие, с захватом света они справляются если не лучше, то точно не хуже. То есть физика всё ещё решает.

Во-вторых, маркетологи этих компаний не принимают наркотики и не придумывают потом невообразимые примеры использования 108-мегапиксельных фотографий. Они игнорируют большие цифры и идут другим путём. Обе компании поставили на искусственный интеллект алгоритмы, которые уже на этапе постобработки превращают фото чуть ли не в произведение искусства. А именно этого и хочет простой пользователь — сфоткать и получить красоту. Без штатива, без настроек, без траты времени.

Источник

В Apple рассказали, почему камера iPhone лучше, чем у других смартфонов

Несмотря на рост количества камер и повышение их технологичности, конечная цель Apple в развитии фотографических возможностей iPhone состоит в том, чтобы просто делать качественные снимки в одно нажатие. Об этом рассказал Джон МакКормик, глава отдела разработки и проектирования мобильных камер Apple. По его словам, в Купертино всегда старались сделать так, чтобы результат фотографирования выходил как можно лучше, а сил для этого приходилось тратить как можно меньше. Ведь именно это, как полагают в компании, и отличает мобильную съёмку от профессиональной.

iPhone делают фото на уровне профессиональных камер благодаря особому подходу к проектированию

Что я думаю об iPhone 12 Pro: мнение владельца AppleInsider.ru

Apple стремится скопировать все действия, которые выполняют профессионалы, готовясь к съёмке, признался МакКормик. Но, в отличие от них, в фотографировании на iPhone почти все процессы приходится по максимуму автоматизировать. Ведь пользователю некогда заниматься подстройкой разных параметров, как думают производители Android-смартфонов, да и съёмка, как правило, ведётся не со штатива, а с рук по принципу: достал – нажал – убрал. Поэтому ручное конфигурирование тут попросту не нужно. Добиться намеченного инженерам Apple очень помогают нейросети, которые учатся у настоящих фотографов, а потом применяют полученные знания при съёмке на iPhone.

Почему iPhone снимает лучше Android

Слева — Redmi K30 Zoom, справа — iPhone SE 2020

Фон, передний план, глаза, губы, волосы, одежда, кожа, небо. Наши камеры обрабатывают все эти элементы кадра независимо друг от друга, как в Lightroom, с использованием множества локальных корректировок. Мы настраиваем всё, начиная от экспозиции, контраста и насыщенности кадра, а затем просто объединяем полученные результаты воедино. Мы понимаем, как выглядит еда, и можем оптимизировать цвет и насыщенность, когда это нужно. Небо, как известно, сложнее всего передать правильно, но Smart HDR 3 позволяет нам разбить на сегменты даже его, обрабатывая каждый из них в отдельности, чтобы затем снова соединить их и получить такой же результат, каким его видит человеческий глаз, — сказал МакКормик.

Дизайнеры Apple рассказали, как, кем и сколько разрабатывался iPhone 12

Может показаться, что МакКормик – фантазёр и говорит много лишнего. Но, если оценить фотографии, которые получаются на iPhone, то становится понятно, что это не так. Для меня в этом смысле хорошей лакмусовой бумажкой является портретная съёмка. Большинству смартфонов на Android она даётся довольно плохо, потому что они начинают размывать фон раньше, чем нужно. Из-за этого длинные волосы, уши, шапки и другие выпирающие элементы оказываются в расфокусе. Выглядит это, откровенно говоря, так себе. А у iPhone ничего подобного никогда не было.

Чем уникальна камера iPhone

iPhone одинаково хорошо умеет и в видео, и в фото. В отличие от устройств конкурентов

Одна из целей, которую преследует Apple, состоит в развитии технологии HDR с целью использования её для создания контента. Сложнее всего было добиться съёмки HDR-видео, которое всегда было нишевым и очень сложным продуктом, для создания которого требовались дорогие и очень большие камеры. Но теперь даже моя 15-летняя дочь может создавать полноценные видео Dolby Vision HDR. Поэтому вскоре мы увидим, как появляется всё больше контента, снятого в формате Dolby Vision. С iPhone 12 Pro Max мы можем сделать ещё больше, потому что большой сенсор позволяет ему улавливать больше света за меньший промежуток времени, что способствует лучшей съёмке при недостатке света, — добавил МакКормик.

В целом подход Apple к проектированию камер можно назвать гениальным. В Купертино не пытаются снабдить свои смартфоны множеством настроек, как другие производители, а делают так, чтобы iPhone просто классно фотографировал. Многие не знают, что та же портретная съёмка была запланирована к реализации ещё в 2009 году. Уже тогда Apple выпустила несколько прототипов iPhone с двумя камерами, которые были должны создавать перспективу и размывать задний фон на фотографиях, но были вынуждены отложить эту идею до лучших времён, когда нейросети и процессоры достигнут необходимого уровня развития.

Источник